科技日报记者 张梦然

人工智能(AI)在给出准确答案的同时,也会有一些“胡乱输出”令人难辨真假,这被称为“幻觉”(hallucination)。而新一期《自然》杂志发表的一项研究报道了一种新方法,能检测大语言模型(LLM)产生的“幻觉”,即该方法能测量生成回答的含义的不确定性,或能提升LLM输出答案的可靠性。

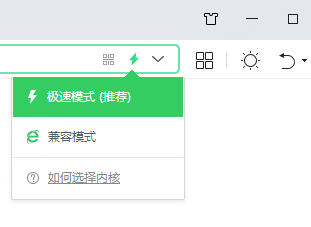

研究团队采用一种新方法可以对生成式AI给出的答案“把关”。

图片来源:《自然》网站

类似ChatGPT和Gemini等LLM,是能阅读和生成自然人类语言的AI系统。不过,这类系统很容易产生所谓“幻觉”,即生成不准确或没有意义的内容。检测LLM出现的这种错误非常难,因为这些回答的呈现方式看起来很可信。

英国牛津大学研究团队此次尝试量化一个LLM产生此类错误的程度,从而判断生成的内容有多忠于提供的源内容。他们的方法能检测“编造”——这是幻觉的一个子类别,特指不准确和随意的内容,常出现在LLM缺乏某类知识的情况下。这种方法考虑了语言的微妙差别,以及回答如何能以不同的方式表达,从而拥有不同的含义。团队的研究表明,他们的方法能在LLM生成的个人简介,以及关于琐事、常识和生命科学这类话题的回答中识别出“编造”内容。

在同时发表的新闻与观点文章中,澳大利亚皇家墨尔本理工大学科学家指出,该方法由一个LLM完成,并通过第三个LLM进行评价,等于在“以毒攻毒”。文章写道,“用一个LLM评估一种基于LLM的方法似乎是在循环论证,而且可能有偏差。”不过,团队指出他们的方法有望帮助用户理解在哪些情况下使用LLM的回答需要注意,也意味着可以提高LLM在更多应用场景中的置信度。

近两年,国内外各种人工智能大模型如雨后春笋般涌现,它们陆续在聊天机器人、智能搜索、文本生成等丰富多样的场景中落地应用。以国内为例,目前用户可通过智能手机下载多款人工智能大模型应用,并与之聊天互动。不过,在应用过程中,人工智能大模型偶尔会“胡言乱语”的问题也受到关注。利用技术手段检测它们是否在“胡言乱语”很有必要,从根本上避免人工智能大模型出现“幻觉”更是急需破解的难题。