科技日报记者 华凌

12月27日,国家地方共建具身智能机器人创新中心(简称创新中心)与北京大学计算机学院联合发布大规模多构型具身智能数据集和检测标准Benchmark——RoboMIND。据悉,其基于成型标准采集,经多个模型训练验证有效,支持多本体多任务并具备通用性,充分解决了目前全球开源数据集,量大但数据质量参差不齐、通用性复用性差、部分数据实测效果不理想等问题,有效满足复杂场景具身智能高效率和针对性训练的需求。

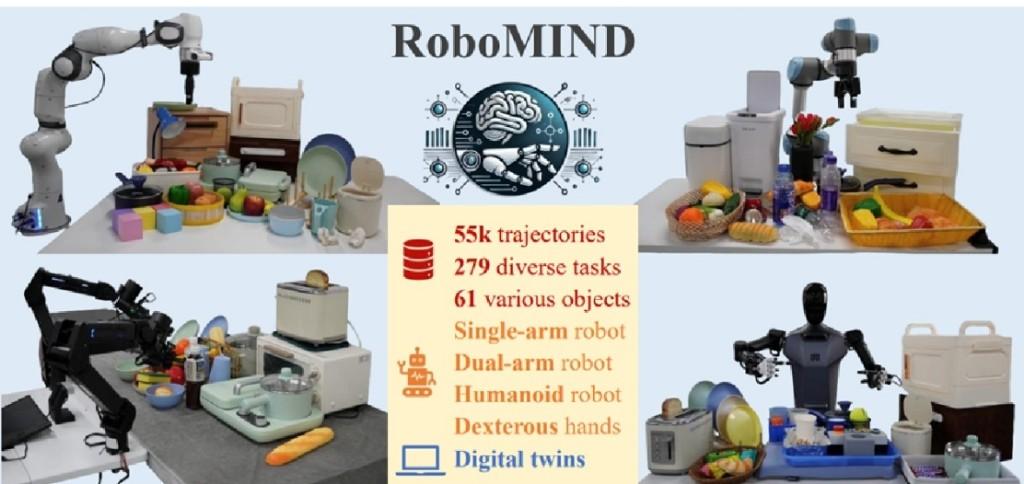

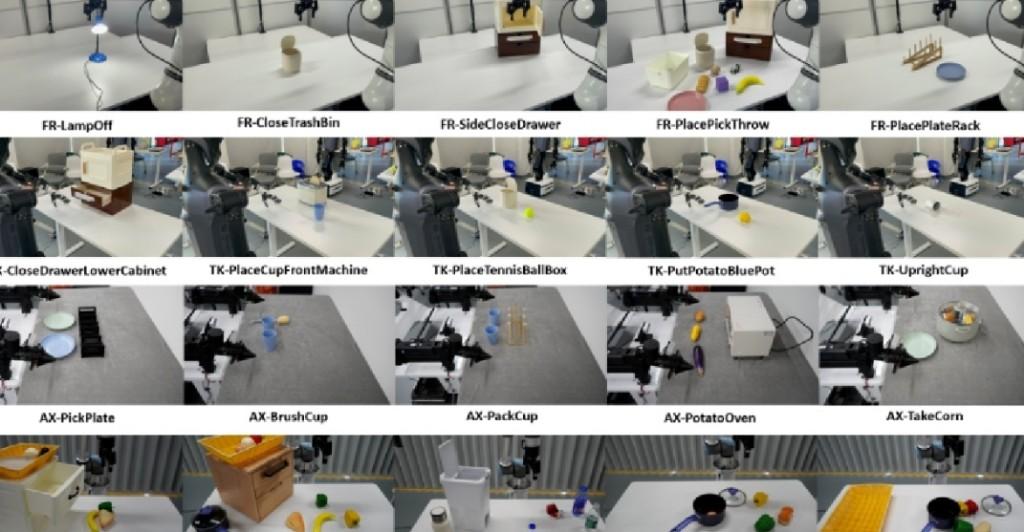

创新中心发布的RoboMind数据集,适用于多平台、多场景、多技能,并且经过多款模型验证有效。

据了解,RoboMIND数据集采用单臂机器人、双臂机器人、人形机器人,手臂末端使用夹爪或者灵巧手等多种机器人进行数据采集,涉及279项不同任务,涵盖高达61种不同的物体,覆盖家居、厨房、工厂、零售等大部分生活服务场景。

创新中心持续采集长程复杂任务的数据,目前已积累数十万条高质量数据,其中以真机数据为主,配以仿真遥操作数据。在数据质量与使用价值上,一条数据等同于目前现有数据集的多条存量数据。创新中心计划首批开源10万条,后续逐步释放,涵盖更多机器人本体和场景任务。

RoboMIND数据集已在主流单任务模仿学习模型(如ACT、BAKU)和具身多模态大模型(如OpenVLA、RDT-1B)进行评测,经多本体和多任务的系统评测,证明RoboMIND数据集有效提升模仿学习模型在现实场景下任务的成功率,率先进入数据集使用的下一阶段。

今年11月,创新中心牵头立项国内首个具身智能数据集的行业标准《人工智能 具身智能 数据采集规范》规范了具身智能数据集采集的格式,加速数据共享开源。12月,创新中心发布《具身智能标准化研究报告》《具身智能数据集及评测研究报告》,为行业的标准化与数据集建设提供指引。

本次创新中心数据集的开放和benchmark的发布,在标准化、有效性和通用性方面均给出突破性结果,并为此后行业的高质量数据集采集打下坚实基础。

(创新中心供图)